Actualités du mois de mai 2009

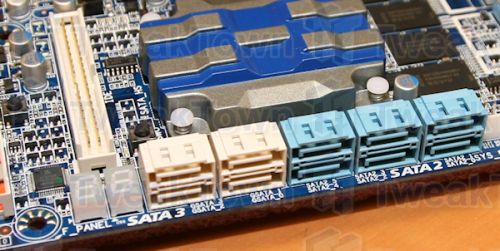

Le SATA-IO, en charge de l'évolution des normes SATA, vient d'officialiser la troisième version de cette norme, connue sous le nom de SATA 3 ou de SATA 6 Gbits/s, une nouvelle évolution qui pourrait être bien utile pour les SSD haut de gamme, déjà très proches des limites actuels du SATA.

Cette nouvelle version apportera en effet un débit doublé, atteignant 6 Gbits/s en débit brut, soit un débit utile de l'ordre de 600 Mo/s. Bien entendu, pour profiter de ce débit, il faudra que les supports de stockage progressent également. Pour les disques durs, ceci n'arrivera probablement pas avant quelques années, mais du côté des SSD, on devrait voir arriver dès cette années des modèles exploitant ce débit grâce à un RAID0 interne ou grâce à de nouveaux contrôleurs haut de gamme, comme par exemple le Jet Stream d'Indilinx, successeur du Barefoot et annoncé à 500 Mo/s. Bien entendu, la compatibilité descendante et ascendante sera assurée, comme avec les évolutions précédentes du SATA.

En dehors du débit, cette nouvelle version offrira un NCQ (Native Command Queing) plus efficace, des nouvelles fonctions d'économies d'énergie, et deux nouveaux connecteurs destinés aux périphériques compacts : les disques 1.8" et les lecteurs 5.25" ultra-slim.

Maintenant que la norme est finalisé, on devrait voir assez rapidement arriver les premiers produits compatibles, notamment du côté des cartes mères. Gigabyte a d'ores et déjà fait la démonstration d'un premier modèle de carte mère P55 pour Core i5 embarquant un contrôleur SATA 3.

Posté par Matt le 28/05/2009 à 22h42

Aucun commentaire

Sources : PCInpact et Matbe

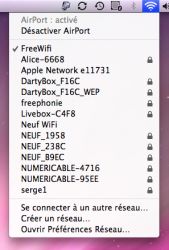

Depuis déjà plus d'un an, les abonnés Neuf Telecom utilisant une Neuf Box peuvent partager leur connexion en configurant leur box en hot-spot Neuf WiFi hot-spot qui pourra ensuite être utilisé par les autres abonnés Neuf Telecom, à condition qu'ils partagent leur propre connexion. Avec un bon train de retard, Free vient de lancer un service équivalent, baptisée Free WiFi, tout simplement.

Réservé aux abonnés disposant d'une Freebox HD, ce service permettra donc de convertir la Freebox en hot-spot Wi-Fi ouvert à tous les autres abonnés Free ayant activé ce service. Mais la ressemblance avec l'offre de Neuf Telecom s'arrête là, Free ayant tout de même ajouté sa petite touche de nouveauté. Tout d'abord, chaque abonné exploitant un hot-spot Wi-Fi se verra attribuer sa propre IP publique, et non pas une simple IP privée, ce qui évitera que plusieurs personnes partagent une même IP publique. Ainsi, il devient possible d'accepter des connexions entrantes, même via un hot-spot, ce qui est indispensable pour certaines applications.

Mais l'idée de Free va encore plus loin : le FAI compte également profiter de ce réseau de hot-spots pour capter de nouveaux abonnés. En effet, il sera possible d'utiliser ces hot-spots pour souscrire à un nouvel abonnement, à condition de payer par carte bancaire et après confirmation par SMS et, en souscrivant de cette manière, le nouvel abonné pourra directement profiter des hot-spots pour se connecter à Internet en attendant que sa ligne soit activée et que sa Freebox lui soit livrée !

Bien entendu, chaque abonné pourra choisir d'activer ou non ce service, comme c'est le cas aujourd'hui avec le service Freephonie et le trafic engendré sera en priorité basse, afin de ne pas dégrader le confort de l'abonné partageur.

Côté chiffre, Free revendique le plus grand réseau Wi-Fi communautaire, avec plus de 3 millions de points d'accès... à condition bien sûr que tout le monde joue le jeu en activant cette fonction...

Posté par Matt le 27/05/2009 à 15h50

2 commentaires

Source : Macbidouille

Une fois n'est pas coutume, nous vous proposons aujourd'hui le test d'un produit que vous aurez plus de chances de trouver dans un centre commercial que rue Montgallet : la caméra X-Snipe 300 de... Décathlon. Quoi ? Décathlon s'est lancé dans les périphériques informatiques ? Pas tout a fait... La X-Snipe 300 est en fait une caméra un peu particulière : compacte et livrée avec un système de fixation, elle se destine principalement à faire office de caméra embarquée pour les descente en ski ou en VTT, les sorties en moto, etc... D'où sa présence sur les étals de Décathlon.

Proposée à un tarif attractif, elle pourrait intéresser de nombreux amateurs désireux de garder une trace de leurs "exploits". Mais est-elle à la hauteur de ce qu'on pourrait attendre d'un tel produit ? C'est ce que notre motard de service a vérifié dans ce test...

Merci encore à Ptit_boeuf pour ce premier article ;-)

Posté par Ptit_boeuf le 26/05/2009 à 20h54

3 commentaires

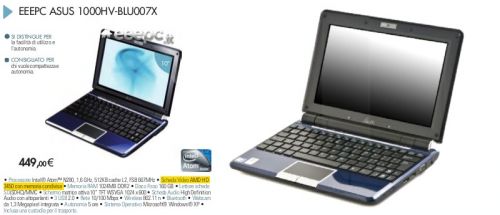

Il y a bientôt deux ans, Asus popularisait le concept du netbook, en lançant son premier ultra-portable à bas prix, l'EEE PC 7". Depuis, ce marché à beaucoup progressé, les modèles se multiplient, les ventes ont explosé... Mais ces machines pêchent toujours par un manque de puissance, ce qu'Asus semble vouloir faire changer avec son nouveau modèle, l'EEE PC 1000 HV.

Celui-ci se distingue en effet de ses concurrents par l'intégration d'une vraie carte 3D, dotée de 256 Mo de mémoire dédiée. Bien entendu, il ne faut pas s'attendre à un monstre de puissance, cet EEE se contente d'une simple Mobility Radeon HD 3450, mais compte tenu de la faible résolution de l'écran 10", elle devrait être suffisante pour faire tourner quelques jeux. Elle devrait aussi permettre d'assister le processeur pour le décodage de vidéo HD, l'Atom N280 à 1.66 GHz étant insuffisamment puissant pour effectuer cette tâche par lui même. Le reste de la configuration est tout a fait classique, avec 1 Go de RAM et un disque dur de 160 Go.

Reste à voir si le couple HD 3450 / Atom N280 sera réellement à l'aise dans les jeux, mais aussi si la consommation supplémentaire de la puce graphique ne risque pas d'amputer l'autonomie... Asus annonce en effet seulement 5h d'autonomie avec une batterie 6 cellules, ce qui est bien loin des autonomies record de certains netbooks...

Ce modèle est proposé en Italie pour 450€, mais il s'agit pour l'instant d'une série limitée disponible uniquement chez quelques revendeurs.

Posté par Matt le 23/05/2009 à 15h22

Aucun commentaire

Sources : EEE PC Italia via Matbe

La mode des composants basse consommation ne touche pas que les ordinateurs grand public : Dell s'apprête à lancer une nouvelle gamme de serveurs annoncés avec une consommation particulièrement faible, qui devrait rester inférieure à 30W en charge. De quoi faire plaisir aux entreprises soucieuses de réduire leur empreinte écologiqued'économiser sur leur facture d'électricité.

Pour parvenir à ce résultat, hors de question d'opter pour un processeur serveur classique, même un Xeon ULV consommant à lui tout seul plus que ces 30W. Dell a donc fait un choix original et surprenant : ces serveurs embarqueront un processeur... Via Nano U225 ! Oui, vous avez bien lu, c'est le processeur pour netbooks de Via qui va équiper les serveurs basse consommation de Dell, dans des versions cadencées entre 1.3 et 1.6 GHz.

Baptisés XS11-VX8, ces serveurs devraient être disponibles rapidement, pour 400$. Bien entendu, avec un tel processeur, il ne faudra pas s'attendre à des machines capables de jouer le rôle d'un serveur d'applications, mais il devrait être suffisant pour héberger un site web ou comme serveur de fichiers. Avec une telle consommation, ils devraient également permettre de se passer d'une coûteuse climatisation, ce qui pourrait en faire un très bon choix pour des petites entreprises ayant peu de moyens.

Sur ce secteur des serveurs basse consommation, le XS11-VX8 devra tout de même faire face à la concurrence du X7SLA-L de SuperMicro, qui sera peut-être un peu moins économie en énergie, mais devrait largement l'emporter sur le plan des performances avec son processeur Atom 330, un double-cœur à 1.6 GHz.

Posté par Matt le 20/05/2009 à 11h50

Aucun commentaire

Sources : VNUnet et Matbe

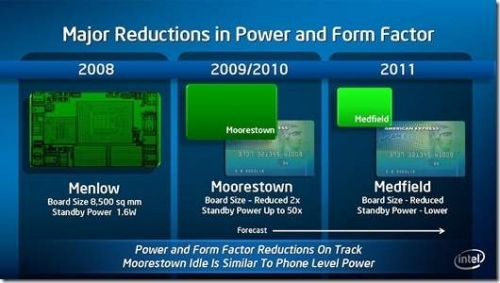

Depuis que la R&D d'Intel a pris le virage de l'optimisation des performances par watt, le fondeur lorgne de plus en plus vers les machines nécessitant une puissance de calcul pas forcément énorme, mais une consommation minimaliste. Après les netbooks, Intel compte désormais s'attaquer à des machines plus petites, mais nécessitant des puces encore moins gourmandes : les smartphones.

Pour ce faire, le fondeur va lancer deux nouvelles plateformes, qui succéderont à l'actuelle plateforme Menlow, destinée aux MID (Mobile Internet Devices) : tout d'abord, la plateforme Moorestown, pour laquelle Intel nous promet une réduction de 50% de la taille de la carte mère, qui deviendrait alors plus petite qu'une carte de crédit, et une réduction de 98% (!!!) de la consommation en idle, ce qui la ramènerait au niveau des solutions actuellement utilisées dans les smartphones. Un peu plus tard, c'est la plateforme Medfield qui prendra la relève, avec une carte mère réduite à la moitié de la taille d'une carte de crédit, et une consommation encore réduite de moitié.

Pour arriver à un tel résultat, la plateforme sera un SoC (System on a Chip) embarquant notamment un cœur Atom et une partie graphique PowerVR, comme l'actuel chipset Poulsbo. La plateforme Moorestown est prévue pour cette année ou l'année prochaine, tandis que Medfiled n'arrivera qu'en 2011. Reste à voir si ces nouvelles plateformes permettront à Intel de revenir sur le marché des PDA et smartphones, que le fondeur a quitté depuis 3 ans en revendant sa division Xscale, qui produisait des processeurs ARM pour appareils mobiles.

En cas de succès, Intel pourra se venter d'avoir imposé le x86 sur quasiment tous les produits informatique, puisque la gamme de processeurs Intel x86 irait du téléphone portable aux supercalculateurs, en passant par les serveurs et les cartes graphiques avec le projet Larrabee.

Posté par Matt le 19/05/2009 à 10h25

Aucun commentaire

Source : Presence PC

Alors que l'architecture GT200 qui équipe les GeForce haut de gamme va bientôt fêter son anniversaire (elle avait été lancée le 16 juin 2008), nVidia prépare activement la relève, sous le nom de code GT300.

Aux dernières nouvelles, les premiers exemplaires fonctionnels du GT300 seraient tout juste sortis des chaînes de TSMC, avec un peu de retard, le fondeur éprouvant apparemment quelques difficultés avec le nouveau proces de gravure. Aux dernières nouvelles, la puce devrait supporter DirectX 11 et les Shader Models 5.0, en fonctionnant à une fréquence de l'ordre de 700 MHz. Elle sera gravée en 40nm par TSMC, à moins que ce dernier continue d'avoir des difficultés avec cette finesse, auquel cas la production pourrait être confiée à UMC.

Les premières cartes embarquant une puce GT300 devraient arriver dans le commerce fin 2009.

Posté par Matt le 18/05/2009 à 22h49

Aucun commentaire

Source : Puissance PC

Présent sur le marché des SSD depuis début 2008, d'abord avec des clones des Samsung PS410, puis avec des modèles moins chers, à base de MLC, OCZ s'y est taillé une réputation peu enviable, à cause justement de ces modèles MLC, construits autour du très décrié contrôleur Jmicron JMF602, dont les performances ne sont pas du tout à la hauteur de ce qu'on serait en droit d'attendre d'un SSD.

Début 2009, OCZ a lancé une nouvelle gamme, les Vertex, déclinée en version MLC et SLC et basée sur un nouveau contrôleur, le Barefoot d'Indilinx. Ils sont clairement positionnés sur un segment plus haut de gamme que leurs précédents modèles, avec comme objectif de redorer le blason d'OCZ, en offrant des performances élevées à un tarif raisonnable.

Alors, promesses tenues ? C'est ce que nous avons vérifié dans notre test...

Posté par Matt le 18/05/2009 à 00h31

6 commentaires

Dimanche dernier, lors du lancement de la nouvelle version d'Infobidouille, je vous avais promis que d'autres nouveautés arriveraient rapidement. La première "livraison" est désormais en ligne...

Au programme :

- une fonction de recherche dans les actualités,

- une liste d'actualités relatives en dessous de chaque actu,

- le lien "Lire la suite" est un peu mieux mis en évidence,

- réécriture du layout des pages, pour un meilleur respect des normes.

Posté par Matt le 16/05/2009 à 18h33

Aucun commentaire

Lancé pour la première fois en 2001, le décryphton est une opération visant à faire avancer la recherche sur les maladies génétiques en partageant la puissance de calcul des ordinateurs de dizaines de milliers d'internautes au sein d'une grille de calcul distribué. Après une seconde vague de calculs en 2005, le projet se lance cette année dans une troisième vague !

Il s'agit de la seconde phase du projet Help Cure Muscular Dystrophy (HCMD) de l’Université Pierre et Marie Curie. Le but du projet est d'analyser les interactions entre 2280 protéines soupçonnées d'avoir un rôle dans des maladies neuromusculaires, cardiaques ou cérébrales. Les estimations des initiateurs du projet tablent sur un besoin de 150 000 internautes sur une durée d'un an.

Les calculs liés à ce projet peuvent être effectués via deux clients de calcul distribués relativement répandus : celui de World Community Grid et BOINC.

Si vous êtes intéressés par ce projet et désirez y participer, vous pouvez vous inscrire sur le site de Décrypthon.

Posté par Matt le 15/05/2009 à 22h31

Aucun commentaire

Source : L'Alliance Francophone

Depuis la GeForce 7950 GX2, première carte bi-GPU d'nVidia, toutes les GeForce à deux GPU ont adopté un design basé sur deux PCB superposés, alors que les cartes bi-GPU d'ATI sont systématiquement réalisées avec un seul PCB. nVidia a toutefois décidé de changer de stratégie, avec une nouvelle GTX 295 basée sur un seul PCB.

En effet, si la solution bi-PCB a l'avantage d'être plus simple à concevoir, elle coûte également plus cher à fabriquer, et est bien plus contraignante au niveau du système de refroidissement, ce dernier étant coincé entre les deux PCB, ce qui limite les arrivées d'air et laisse peu de place à la mise au point de systèmes de refroidissement alternatifs.

La nouvelle GTX 295, dont Inno3D a présenté un exemplaire, se base donc sur un seul PCB comportant deux puces GT200b relativement espacées. Les caractéristiques de la carte sont les mêmes que celles de la GTX 295 originale. On retrouve donc deux GPU à 576 MHz embarquant chacun 240 SP à 1242 MHz et adressant 896 Mo de mémoire GDDR3 à 999 MHz sur un bus 448 bits. La consommation de la carte reste également inchangée, à 289W, ce qui obligera toujours à passer par deux connecteurs d'alimentations, un à 8 broches et un à 6 broches.

On notera par contre la belle performance d'nVidia en termes d'intégration : la carte fait exactement la même longueur que la GTX 295 originale, ce qui veut donc dire que le caméléon a réussi à intégrer tous les composants sur une surface quasiment deux fois moindre (sur les anciens PCB, la surface n'était toutefois pas totalement exploitable, du fait des trous laissés pour alimenter le ventilateur en air frais).

Le système de refroidissement est également original, puisqu'il se compose de deux radiateurs totalement indépendants sur lesquels souffle un unique ventilateur placé au centre de la carte. Un choix qui pourrait ne pas se révéler des plus judicieux dans certaines situations : dans les jeux non supportés par le SLI, lorsqu'un seul GPU est utilisé à pleine charge, un radiateur unique aurait permis de maintenir ce GPU à une température raisonnable sans trop forcer sur le ventilateur...

Du côté des tarifs, Inno3D annonce un prix de 499$, conforme au prix public conseillé par nVidia. Posséder la carte graphique la plus puissante du moment reste donc coûteux, même si on est loin des tarifs qu'atteignaient les cartes les plus haut de gamme il y a trois ou quatre ans.

Posté par Matt le 14/05/2009 à 10h30

Aucun commentaire

Source : Matbe

Phoronix a publié un comparatif de performances très complet entre Mac OS X 10.5.6 (Leopard) et Ubuntu 9.04 (Jaunty Jackalope) sur une même machine, un Mac Mini Core 2 Duo 1.83 GHz équipé d'1 Go de RAM et d'un disque dur de 80 Go. L'occasion de vérifier si l'OS libre arrive à atteindre le niveau de performances d'une solution propriétaire...

Et n'en déplaise aux partisans du pingouin, il semblerait bien que non, Ubuntu 9.04 se révélant globalement plus lent que l'OS de la pomme. Ainsi, parmi les 29 benchmarks exécutés, 17 ont donné l'avantage à Mac OS X. Ce dernier prend l'avantage dans les jeux vidéos, l'encodage audio, ou encore la gestion de bases de données, tandis qu'Ubuntu prend un léger avantage dans l'encodage vidéo, les tâches de développement (compilation), la cryptographie, mais aussi et surtout, dans les tests Java, le langage de Sun ne semblant pas très à la fête sous Mac OS X...

Dommage que le testeur n'ait pas poussé l'idée jusqu'au bout, en intégrant aussi les résultats obtenus avec Windows XP ou Windows Vista. Il serait également intéressant de voir les résultats avec Mac OS X 10.6 (Snow Leopard) lorsqu'il sera disponible, Apple ayant essentiellement effectué un travail d'optimisation sur cette future version, afin d'exploiter au mieux la puissance des machines actuelles.

Posté par Matt le 13/05/2009 à 22h42

1 commentaire

Source : DV Hardware

Le 10 avril dernier, lorsque le projet de loi Création et Internet (dite HADOPI) avait été rejeté lors du vote de l'assemblée nationale, la ministre de la culture et le rapporteur du texte avaient promis de soumettre rapidement une nouvelle version du texte à la votation des députés. La nouvelle version a obtenu aujourd'hui l'aval de l'assemblée.

Même si le pour l'a emporté de peu (296 contre 233), c'est une nouveau coup dur pour les opposants à cette loi, qui ont désormais peu d'espoir de la voir tomber dans les oubliettes... En effet, il ne reste désormais plus qu'une étape avant que le texte soit définitivement adopté : il doit être voté en l'état par le sénat. Si le sénat venait à modifier le texte avant de le voter, celui-ci devrait faire un nouveau passage devant l'assemblée, mais tout semble avoir été fait pour limiter le plus possible le risque de voir le texte amendé par le sénat : le vote aura lieu dès demain, laissant donc très peu de temps pour débattre et déposer d'éventuels amendements...

Maintenant que le sort du texte semble fixé, il est temps de se demander à nouveau si la loi sera réellement applicable, mais aussi si elle ne va pas coûter très cher au contribuable pour un résultat discutable... En effet, sur le plan technique, la loi restera difficile à mettre en œuvre, tant les possibilités de contournement sont larges, tandis que le manque de sécurité des connexions Wi-Fi risque de provoquer de nombreux faux-positifs, d'autant plus que les principaux serveurs des réseaux P2P ont pris l'habitude de diffuser de fausses adresses IP pour noyer le poisson...

Enfin, on rappellera que, la semaine dernière, le parlement européen a voté avec une très large majorité (88%) l'amendement 138 du paquet télécom (dit amendement Bono), qui précise que seule une autorité judiciaire peut décider de la suspension d'une connexion Internet, ce qui n'est pas le cas de l'HADOPI... La loi serait donc non conforme au droit européen, et devrait donc être abrogée, le droit communautaire était prioritaire sur le droit national... Guy Bono n'a d'ailleurs pas tardé à s'exprimer sur le sujet : Alors que le principe de riposte graduée vient d'être rejeté la semaine dernière par 88% des députés européens, l'Assemblée nationale s'est finalement pliée à la volonté présidentielle en adoptant le projet de loi Création et Internet. Pour flatter l'orgueil du prince, la majorité s'entête à vouloir faire passer un texte dont elle sait pertinemment qu'il sera contraire au droit communautaire. C'est un mépris total de l'Europe et de ses concitoyens à trois semaines des élections européennes

.

L'eurodéputé va d'ailleurs demander à la commission européenne d'ouvrir une procédure contre la France pour violation du droit communautaire.

Posté par Matt le 12/05/2009 à 20h12

Aucun commentaire

Source : PCInpact

Lorsque Google a lancé son navigateur web Google Chrome il y a quelques mois, celui-ci était le premier à proposer une nouvelle architecture dans laquelle chaque onglet est un processus indépendant des autres. Internet Explorer 8 lui a emboîté le pas, et Firefox devrait (enfin...) faire de même d'ici quelques temps.

En effet, à partir du mois de juillet, les versions de développement de Firefox commenceront petit à petit à adapter ce mode de fonctionnement. Dans un premier temps, aux environ de la mi-juillet, les briques de bases seront posées, avec un gestionnaire de processus, et un processus par onglet, mais avec très peu d'interaction entre ces processus. Dès novembre, cette gestion multi-processus devrait être plus avancée, avec notamment une meilleure gestion des sessions, et une optimisation des accès concurrents aux profiles, qui se feront via le processus principal.

Dans la troisième phase, pré-requis avant la mise à disposition au grand public, la gestion des extensions devrait être adaptée pour fonctionner au sein des différents processus, tandis que les performances seront optimisées. Enfin, à plus long terme, les développeurs envisagent la possibilité de personnaliser fortement le découpage en processus, en permettant de choisir de grouper plusieurs onglets dans un processus, de définir des processus dédiés à certains domaines, d'améliorer l'isolation entre les processus pour améliorer la sécurité, etc...

Vous trouverez plus de détail sur ces nouveautés sur le wiki de la fondation Mozilla.

Bref, c'est un gros travail qui attend les développeurs de Firefox, et malheureusement pour les utilisateurs, il faudra sans doute encore au moins 12 à 18 mois avant qu'un Firefox multi-processus stable et fonctionnel soit disponible. Une fois n'est pas coutume, Firefox est donc bien à la traine sur ce dossier, avec au moins deux ans de retard sur Google Chrome...

Posté par Matt le 11/05/2009 à 22h37

Aucun commentaire

Source : PCWorld

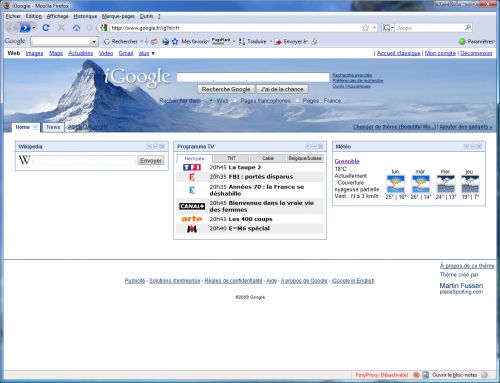

En ce dimanche 10 mai 2009, Infobidouille fête son troisième printemps ! Pour l'occasion, le site fait peau neuve (version 3), et il était temps, les bases de l'ancienne charte graphique commençant a se faire vraiment vieillotte...

Toute en rondeur (sur les navigateurs modernes...), la nouvelle charte graphique propose une nouvelle organisation des informations, pour les rendre plus accessibles. Le menu vertical de gauche est remplacé par des menus déroulants horizontaux, et un nouveau menu vertical fait son apparition sur la droite de la page, pour reprendre les titres des 20 dernières actualités, des 10 derniers billets sur les blogs, le tout accompagné d'un nuage de tag, nouveauté de cette version.

Le corps de la page reprend l'en-tête des cinq premières actualités, afin qu'elles soient accessibles directement depuis la page d'accueil, tandis que la présentation du corps a été uniformisée entre les différentes pages du site. AJAX fait également son entrée sur le site, via le plug-in LightBox de Dotclear, qui facilitera le visionnage des images des actualités et des articles.

Pour profiter pleinement de ce nouveau design, nous vous recommandons l'utilisation d'un navigateur moderne, tel que Firefox, Safari ou Chrome. En effet, Internet Explorer, même en version 8, ne supporte pas encore tous les éléments de style utilisés dans cette nouvelle version. Pour faire la comparaison, voici les rendus d'Infobidouille v2 sous Firefox, v3 sous Firefox et v3 sous IE8 :

D'autres nouveautés sont d'ores et déjà prévues, mais ne sont pas encore prêtes faute de temps. Elles seront intégrées au site petit à petit.

Posté par Matt le 10/05/2009 à 00h01

4 commentaires

Après le raz de marré des netbooks, aura-t-on droit au raz de marré des nettops, le pendant desktop du netbook ? C'est en tout cas ce qu'espèrent la plupart des constructeurs de netbooks, qui se sont lancés sur ce créneau, mais avec des machines manquant souvent d'originalité, rarement plus qu'un netbook dépourvu d'écran... Mais les choses pourraient changer avec le Dign-Lab...

Originaire de Corée, ce nettop à base d'Atom se distingue en effet de la concurrence par un "détail" : il est intégré à un écran LCD 19" tactile. Associé à un logiciel adapté, cet écran pourrait faire du Dign-Lab une machine idéale pour remplacer une chaîne hi-fi et pour faire une machine d'appoint pour le surf, d'autant que son prix s'annonce particulièrement séduisant : ce nettop devrait être proposé pour moins de 300$ !

Son constructeur n'a par contre pas communiqué plus d'informations, ni sur ses caractéristiques (si ce n'est que le processeur sera un Atom), ni sur sa date de disponibilité...

Posté par Matt le 08/05/2009 à 20h29

Aucun commentaire

Source : Newslaunches.com

Comme prévu, Microsoft a commencé à diffuser aujourd'hui la première "Release Candidate" (c'est-à-dire une version quasi finale) de Windows 7, le successeur de Windows Vista. Cette RC est proposée en téléchargement gratuit et en cinq langues, dont le français.

Microsoft compte énormément sur cette version pour redresser la barre, après l'échec commercial de Vista. Pour ce faire, Microsoft a choisi de sortir les grands moyens, mais de le faire en tout discrétion. Ainsi, Redmond communique relativement peu sur cette nouvelle version, mais les changements sont bien là.

Tout d'abord, l'interface graphique a été revue. En plus d'une ergonomie théoriquement améliorée (mais pour laquelle il faudra forcément un temps d'adaptation...), cette nouvelle version semble avoir été réalisée avec plus de souci du détail, ce qui résulte en une plus grande cohérence entre les différents modules du système, même si cette cohérence n'est pas encore parfaite.

Par ailleurs, Microsoft s'est également attaqué à des parties moins visibles, en les optimisant pour rendre le système plus réactif, mais aussi plus adapté à des configurations légères et aux portables, avec notamment de nouvelles solutions destinées à réduire la consommation de la machine au repos, en la sollicitant moins.

La gestion réseau bénéficie également d'un nouvel assistant, permettant de simplifier grandement le partage de fichiers sur le réseau local, en créant un groupe domestique, protégé par mot de passe, et qui pourra se configurer automatiquement sur toutes les machines Windows 7 d'un même réseau local, tandis que de nouvelles fonctions permettront d'accéder à distance à aux fichiers multimédia, via le service Windows Live.

Enfin, comme nous vous l'expliquions il y a quelques jours, Windows 7 intégrera une machine virtuelle Windows XP, permettant d'exécuter les logiciels les plus récalcitrants à ce nouvel OS.

Cette version RC sera disponible au téléchargement jusqu'au 1er juillet 2009, tandis que la version finale est attendue pour l'automne, voire la fin de l'été. La version RC pourra être utilisée jusqu'au 1er juin 2010, mais sera limitée à des périodes d'utilisation de deux heures à partir du 1er mars 2010.

Posté par Matt le 06/05/2009 à 00h03

Aucun commentaire

En ces temps difficile pour l'économie mondiale, le géant de l'Internet embauche... des chèvres et un border collie ! Surprenant, non ? Cette "embauche" entre en fait dans le cadre de la politique "verte" de Google.

En effet, le grand campus de Mountain View a besoin d'être débroussaillé à l'approche de l'été, pour freiner la progression d'éventuels incendies de forêt, incendies qui sont courants en Californie. Mais plutôt que de faire appel à une équipe d'ouvriers équipés de débroussailleurs, bruyant et polluants Google a opté pour une technique de débroussaillage écologique, en louant pour une semaine les services d'un troupeau de 200 chèvres et de Jen, leur chien de garde.

Selon le blog de Google, les sympathiques brouteuses devraient aussi assurer la fertilisation du terrain, ce qui ne sera pas forcément des plus agréables pour les narines et les chaussures des employés...